大数据时代下数据中心的发展思考与数据处理新范式

随着信息技术的飞速发展,我们已全面步入大数据时代。数据,作为新时代的核心生产要素,其规模呈爆炸式增长,形态日益复杂多样。这既为各行各业带来了前所未有的机遇,也对作为数据存储、计算与管理核心枢纽的数据中心提出了严峻挑战与更高要求。数据中心的发展,已不仅是技术设施的迭代,更是关乎数字经济底座稳固与未来竞争力的战略议题。数据处理作为数据中心的核心职能,其理念、技术与架构也正经历着深刻的变革。

一、 数据中心的发展趋势:从“存储仓库”到“智能引擎”

传统数据中心主要扮演着数据“存储仓库”和“计算机房”的角色。在大数据与人工智能(AI)深度融合的驱动下,现代数据中心正加速向智能化、绿色化、分布式与云边协同方向演进。

- 算力需求驱动架构变革:海量数据的实时分析与AI模型训练,催生了以GPU、NPU等为代表的异构算力需求。数据中心架构正从以CPU为中心的通用计算,转向CPU、GPU、FPGA等多种计算单元协同的异构计算架构,以提供更高效、更专用的数据处理能力。

- 绿色可持续发展成为硬性要求:数据中心的能耗问题日益突出,“双碳”目标下,降低PUE(电能使用效率)成为行业共识。通过采用液冷、自然冷却、高压直流供电、AI智能调优、可再生能源利用等技术,建设绿色低碳数据中心已成为不可逆转的趋势。

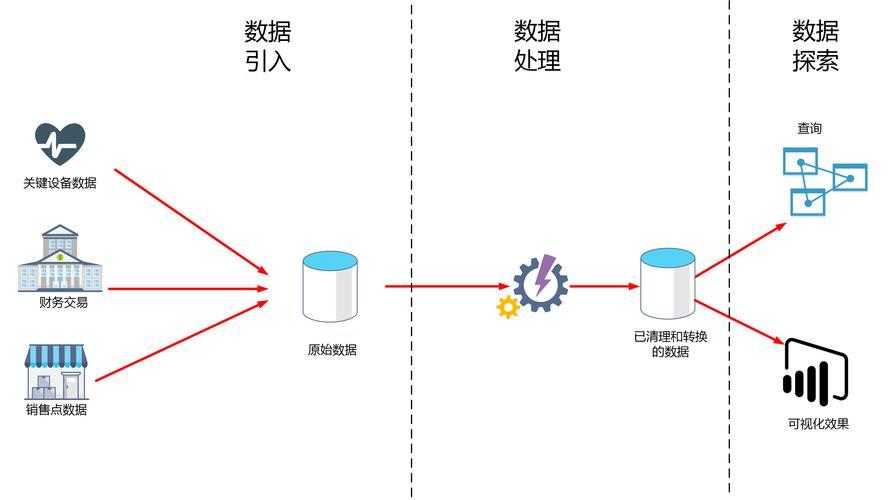

- 云边端协同与分布式部署:为应对物联网(IoT)产生的海量边缘数据及低时延应用需求,数据中心形态从集中式大型云数据中心,向“核心云-边缘云-终端设备”多级协同的分布式架构延伸。边缘数据中心负责数据的就近预处理与实时响应,核心云数据中心则聚焦于海量数据的深度汇聚、存储与复杂模型训练,形成高效协同的数据处理网络。

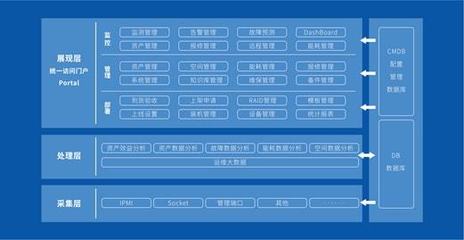

- 自动化与智能化运维(AIOps):面对日益庞大的基础设施规模与复杂的业务系统,依靠人工的运维模式难以为继。通过引入AI与机器学习技术,实现数据中心基础设施(供电、制冷)与IT资源(服务器、网络、存储)的智能监控、故障预测、根因分析及自动化修复,已成为提升运营效率与可靠性的关键。

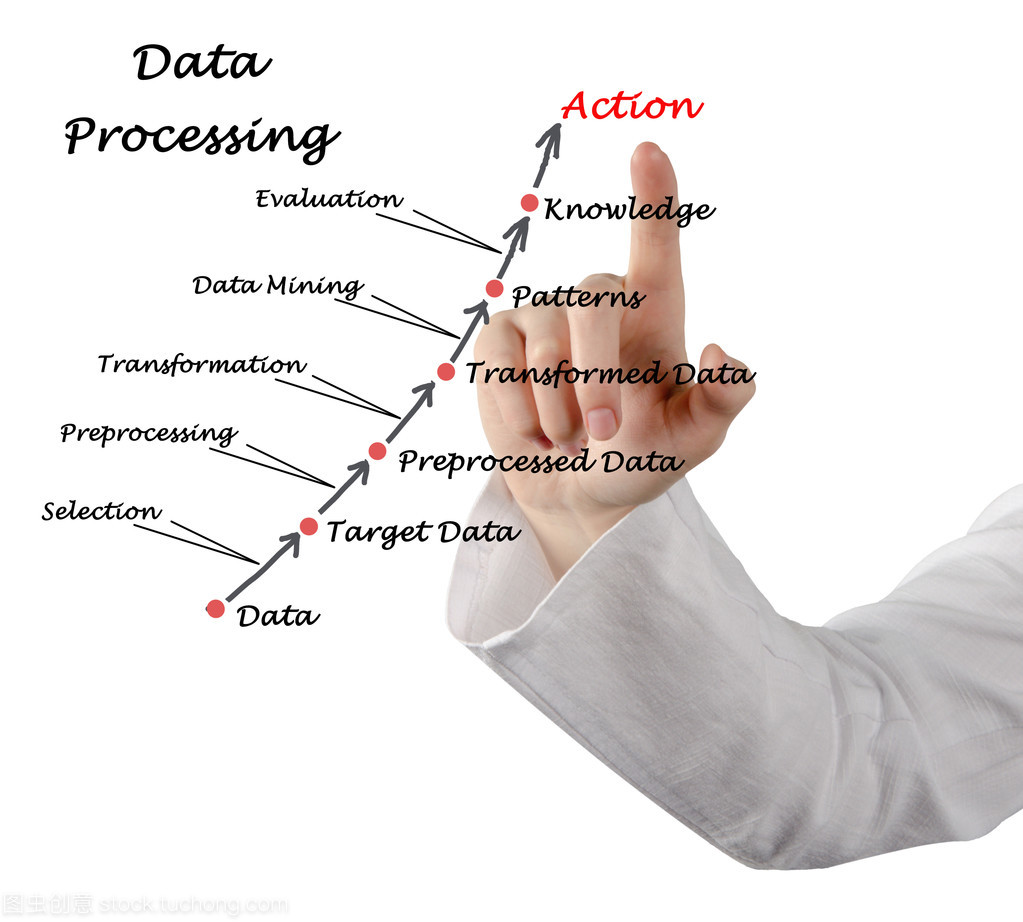

二、 数据处理范式的演进:从“事后分析”到“实时智能”

数据处理能力的升级是数据中心价值跃迁的核心。大数据时代的数据处理已超越传统批量处理(Batch Processing)的范畴,呈现出流批一体、湖仓融合、数据编织(Data Fabric)等新特征。

- 流批一体化处理:为满足实时业务决策(如金融风控、实时推荐)与历史数据深度挖掘的双重需求,数据处理引擎正朝着统一流批处理的方向发展。这意味着同一套计算框架或API可以同时处理无界数据流和有界数据集,简化架构,减少数据冗余,并保证数据处理逻辑的一致性。

- 湖仓一体(Lakehouse)架构兴起:传统数据湖(灵活存储原始数据)与数据仓库(高度结构化、支持高性能分析)的界限正在模糊。湖仓一体架构试图融合两者的优势:在低成本、开放格式的数据湖存储之上,构建数据仓库级的管理、性能与ACID事务特性,支持从BI报表、SQL查询到机器学习、实时分析等多种工作负载,打破数据孤岛。

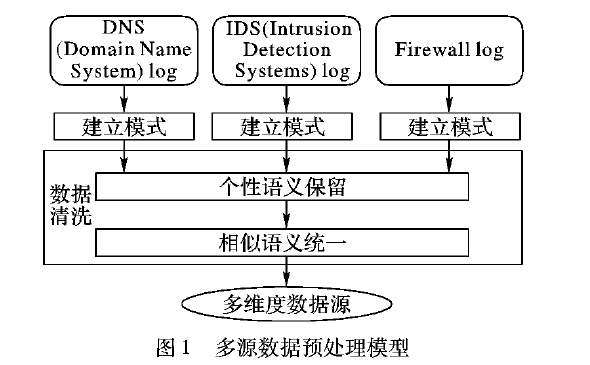

- 数据编织与主动元数据管理:随着数据源、数据类型和数据处理工具的激增,数据发现、理解、信任与整合的复杂度剧增。数据编织是一种新兴的架构方法,它利用主动元数据、知识图谱、AI/ML和自动化技术,动态连接、优化和管理分散在不同环境中的数据资产,提供无缝的数据访问、集成与治理体验,使数据随时可供使用且可信。

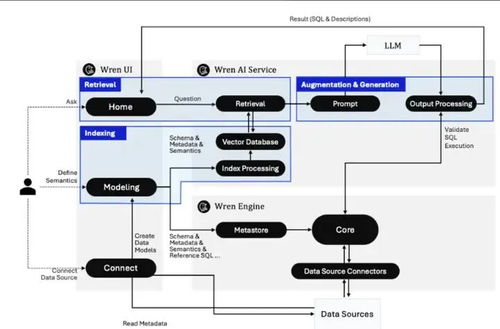

- 数据处理与AI的深度耦合:数据处理流程正深度集成AI能力。一方面,AI模型训练需要高质量的数据处理管道(Data Pipeline)进行数据清洗、标注与增强;另一方面,AI技术也被用于优化数据处理过程本身,如智能数据分层、自动查询优化、异常检测等,形成“数据喂养AI,AI优化数据处理”的良性循环。

三、 未来展望与思考

面向数据中心及其承载的数据处理能力,将成为国家与企业的核心数字竞争力。未来的发展需重点关注:

- 软硬件协同创新:持续推动芯片(如DPU)、服务器、网络、存储等硬件与操作系统、数据库、大数据平台等软件的协同设计与优化,以释放极致性能。

- 安全与隐私保护:在数据全生命周期内,构建内生安全体系,利用同态加密、联邦学习、可信执行环境等技术,实现“数据可用不可见”,平衡数据价值挖掘与隐私安全保护。

- 标准化与开放性:推动数据中心基础设施、数据接口、管理协议的标准化与开源开放,降低生态锁定的风险,促进技术创新与产业健康发展。

- 人才与组织转型:培养既懂数据中心基础设施,又精通大数据、AI技术的复合型人才,并推动组织向数据驱动、敏捷协作的文化转型。

大数据时代的数据中心,正从成本中心演变为价值创造中心。其发展必须紧扣数据处理需求的变化,通过持续的技术创新与架构演进,构建敏捷、高效、绿色、安全的智能数据基础设施,从而充分释放数据要素潜能,赋能千行百业的数字化转型与智能化升级。

如若转载,请注明出处:http://www.smxlzj.com/product/81.html

更新时间:2026-06-01 08:10:01